Por José Claudio Escribano

Para LA GACETA - MADRID

Estamos ante un nuevo punto de inflexión de la historia.

Lo magnifica el debate de si controlaremos de algún modo o no las acciones de la inteligencia artificial que generen amenazas para el destino de la humanidad. Está fuera de la discusión, desde luego, el reconocimiento por los logros, tan evidentes como extraordinarios, obtenidos en las más diversas disciplinas del conocimiento. El hombre ha sido hasta aquí determinante en esas conquistas.

Ha hecho maravillas. Desde las comunicaciones a la medicina, desde la educación y las investigaciones espaciales a las relaciones laborales, a la recreación, la energía y la logística, las artes, los transportes, las actividades industriales, comerciales y agrícolas. La tecnología fundada en la información acumulativa de bases enormes de datos lo ha transformado todo y su proyección en el tiempo plantea cuestiones hasta sobre la suerte que podrían correr las instituciones de nuestra cultura y la democracia como sistema de gobierno.

No es necesario ir tan lejos ni agarrar por el cuello a los programadores de algoritmos para automóviles sin conductor en el afán de que suelten si habían tenido en cuenta algunas cosas simples como las comenta Frank Pascuale, profesor de Derecho en la Universidad de Cornell: en adelante, los terroristas no tendrán que reclutar suicidas con bombas si ya pueden cargar explosivos en vehículos de conducción automatizada.

Hay miles de preguntas parecidas en esa categoría de las paradojas del progreso, pero lo central seguirá siendo si dejaremos que los grandes actores de naturaleza inorgánica invadan la sacralidad humana sin oponerles normas éticas y legales. Cuando en 2022 Elon Musk y Sam Altman lanzaron al mercado, a través de Open AI al ChatGPT, expertos en computación dijeron que se había abierto una caja de Pandora y junto con ellos llamaron a una frágil moratoria de seis meses sobre la nueva joya digital.

John Hopfield, de Princeton, y Geoffrey Hinton, de la Universidad de Toronto, obtuvieron el martes último el Premio Nobel de Física por sus contribuciones al desarrollo de la inteligencia artificial, pero expresaron temores por la posibilidad de que se salga del control humano e instaron a utilizarla de manera segura y ética.

Líderes mundiales como Henry Kissinger, en el libro de despedida del año último antes de su muerte a los 98 años, que escribió con un exdirector ejecutivo de Google y un científico computacional del Instituto Tecnológico de Massachussets, dejaron constancia de su zozobra por la eventualidad de un mundo cruzado de brazos frente a los riesgos existentes.

Hace dos semanas hubo un gran hecho promisorio, que define la temperatura creciente por el tema. Entre las 56 acciones contempladas por la asamblea general de las Naciones Unidas, en su consenso sobre un Pacto para el Futuro, se instó a la cooperación internacional para establecer reglas en el uso de la Inteligencia Artificial. La Argentina se excluyó del compromiso en contradicción con la propaganda de que está abierta al mundo.

Las máquinas y la conciencia

Uno de los capítulos más dramáticos en debate es si las máquinas digitales podrían establecer por sí mismas objetivos propios. Hay quienes dicen que sí; otros, dicen que no. Que las máquinas carecen por principio de conciencia y que no podrían simularla. Resolví tomar el tema en mis manos y preguntar al ChatGPT:

-Hablemos en serio. ¿Eres capaz de distinguir el bien del mal? -Tardó un segundo en contestar:

-No, no tengo conciencia ni capacidad para dudar entre el bien y mal como lo haría un ser humano. Soy una inteligencia artificial diseñada para procesar y generar información basada en patrones y algoritmos.

Volví a la carga: ¿Imaginas el día en que tengas conciencia y objetivos propios? -Contestó:

-Es una pregunta interesante y exploraría la idea de lo que significa contar con esos atributos -dijo en el estilo elusivo que lo caracteriza en esos asuntos.

En la misma línea precavida de Kissinger se pronunció en la reunión del G7 el papa Bergoglio en uno de sus mensajes menos polémicos del año. Armen Avanessian, filósofo austríaco, que escribió Meta-Futuros. Perspectiva para el mundo que viene, dice que el mundo se nos aparece como un código secreto en manos de unos pocos monopolios que gozan de una soberanía interpretativa solo quebrantada por herejes chamánicos, los malditos hackers. Eso explica un fallo de 2022 de la Corte Suprema de Justicia de la Argentina, sugiriendo que es hora de descorrer el velo de la “opacidad” algorítmica.

Las miradas se dirigen a quienes comandan este mundo tecnológico. A fines de agosto último, la capitalización total de Microsoft, Apple, Nvidia, Alphabet (Google) y Amazon, las cinco más grandes tecnológicas, era de 12,8 billones de dólares. Para que se entienda mejor: unas veinte veces el PBI de la Argentina. Algunos de esos colosos mantienen abiertas, más allá de acuerdos precarios que se renuevan periódicamente, disputas por el usufructo de la propiedad intelectual de los contenidos de medios periodísticos. Estos vociferan, en defensa de sus derechos intelectuales, que se acabe el almuerzo gratis y las redes y buscadores acaten tres reglas de oro: consentimiento, retribución y atribución.

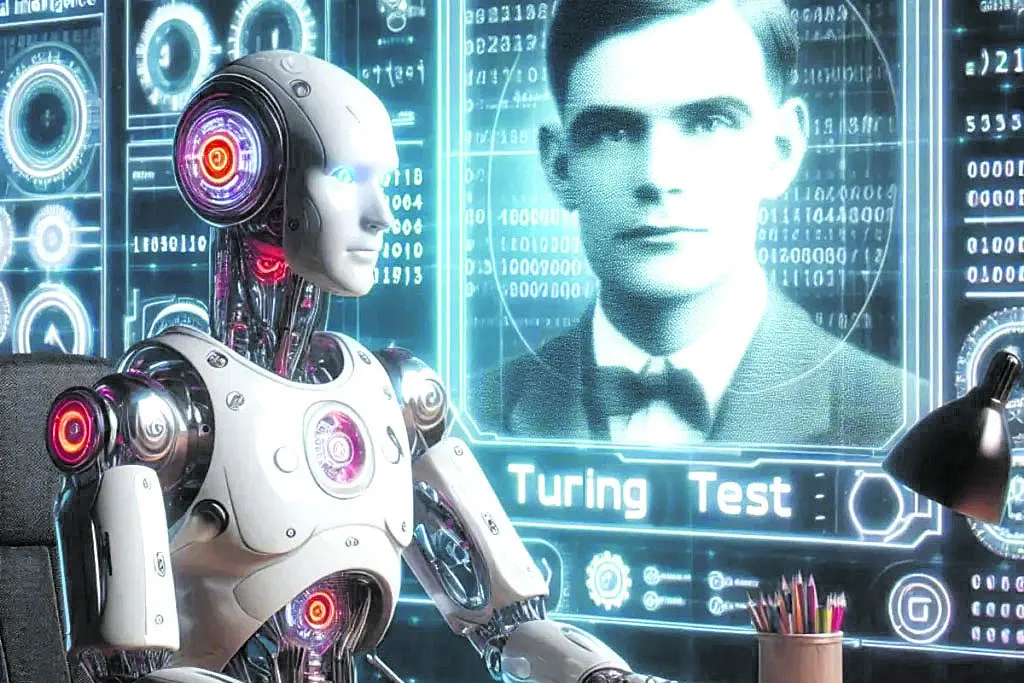

El test de Turing

Hace 75 años, Alan Turing, precursor de la informática, se preguntaba por las condiciones que debería revestir una máquina para considerarla provista de inteligencia artificial. Turing dijo que eso sucedería cuando tuviera destellos de comportamiento autónomo y resultara problemático distinguir entre la palabra humana y la de una máquina. Y bien, habilitadas por masas monumentales de datos, las deepfakes reconstruyen hoy no solo nuestra voz; también nuestra imagen.

El momento anticipado por Turing llegó hace años. Sus consecuencias se expandieron entre estallidos de admiración, estupor e inquietud en paulatino aumento. Algunos de los instrumentos de aplicación digital están hoy en manos de 4.500 millones de hombres y mujeres; o sea, en más de media humanidad.

El ritmo de esta revolución podría acelerarse, en palabras de Bergoglio, “con la introducción de los ordenadores cuánticos que no operan con circuitos binarios (semiconductores o microchips), sino según las leyes, bastante articuladas, de la física cuántica”. Expertos en esta ardua disciplina dicen que los procesadores de esa naturaleza requerirían para funcionar de temperaturas bajo cero de unos 270 grados y que eso sujetará al genio dentro de la lámpara por largo tiempo.

Ya había suficientes motivos para reflexionar sobre el futuro de la humanidad desde que empezamos a desafiar el equilibrio del ecosistema terrenal y las leyes del orden climático. Desde esa perspectiva nos hemos ganado, junto con nuestros más desprevenidos ancestros de la Revolución Industrial, el reproche de haber inaugurado una era devastadora no obstante el desarrollo obtenido en tantos otros órdenes.

Definimos a la nueva hora -la hora del antropoceno-, en términos geológicos, por el impacto del hombre sobre la naturaleza y, en términos sociológicos, por el desdén en aniquilar cuantiosos bienes de la flora, la fauna, los suelos y los mares, y por los efectos que esta depredación inferirá, de no detenerse, en la salud física y espiritual de futuras generaciones. Vuelan por arriba de ese piso las preguntas sobre la relación entre tecnología e identidad humana. Y hasta hay quienes con lucidez hablan de la Fe de la Edad Media y de la Razón iluminista que precedió a la Revolución Francesa, en referencia a la fuerza que terminaría impulsando, en defecto de aquellas otras, la historia en un mundo regido por máquinas digitales y no por hombres que empiezan por perder habilidades al ser sustituidos por la tecnología.

De modo que si se produjera una fatalidad de dimensiones bíblicas nadie podrá decir que faltaron los llamados de atención de que los instrumentos tecnológicos debían ser aplicados para beneficio de la humanidad y no para rebajarla en su dignidad o provocar su extinción. ¿Qué representaría, si no, el cumplimiento profético del tantas veces citado Marvin Minsky, profesor del Instituto Tecnológico de Massachussets y uno de los padres de la IA, fallecido hace años, de que en 2034 las máquinas tomarían conciencia de sí mismas y del control del mundo?

Karl Popper, en La miseria del historicismo, dice que por razones estrictamente lógicas no es posible predecir el futuro. Que el curso de la historia está fuertemente influido por los nuevos conocimientos y que precisamente por eso no podemos anticipar hoy lo que solo sabremos mañana. En ciencia política estamos en demasía escarmentados por el fracaso profético, según comprobamos a diario y, sobre todo, cuando compartimos foros con gobernantes y politólogos.

Entre la tecnofobia y la tecnofilia

¿Cómo encontrar el punto medio que conjure, en una alianza de la ética y la política, que la máquina actúe como instrumento de aprendizaje autónomo en guerras y, al mismo tiempo, se evite malograr otros logros benéficos para la humanidad? ¿Dónde hallar la sabiduría que nos sustraiga de la tecnofobia paleolítica que paraliza, pero también de la osadía de encarnar una desmedida tecnofilia? En esa espinosa reflexión es imposible olvidar a Popper: la ciencia está, por principio, urgida en acuciar la competencia entre las hipótesis y el rigor experimental.

En el mensaje ante el G7, Bergolio discrepó de la creencia en que las observaciones obtenidas de un mecanismo de cálculo como los logaritmos estén dotadas de certeza y universalidad irrefutables. En términos más rudimentarios de los que podrían firmar los doctos académicos pontificios supuestamente consultados por el Papa, un algoritmo es un conjunto finito de operaciones matemáticas realizadas dentro de un cierto orden con el propósito de llegar a un resultado..

Bergoglio bajó a tierra un caso concreto de preocupación. Fue cuando apuntó a los programas de inteligencia artificial generativa utilizados a fin de asistir a magistrados judiciales en el otorgamiento de prisión domiciliaria a presos carcelarios. Observó que la IA está preparada para atender, a requerimiento judicial, la posibilidad de reincidencia en el delito cometido según categorías prefijadas: comportamiento en prisión, evaluación psicoanalítica, y demás. El algoritmo se nutre también de otros datos en ese tipo de temas: origen étnico, nivel educativo, capacidad, etcétera, del procesado o condenado.

El Papa se preguntó cómo sabemos si esas categorías de evaluación están descontaminadas de prejuicios. ¿Cómo podría la máquina apreciar el dato crucial de que el hombre es un ser en permanente evolución, precisamente porque es un ser inacabado, y cómo registraría las variaciones en la sensibilidad humana? Es una apreciación compartida por líderes religiosos de diversos credos: cristianos, judíos, musulmanes, budistas, y hasta los zoroastristas, según se comprobó en reuniones mundiales.

Después del revés de Francis Fukuyama de hablar, tal vez por apresuramiento intelectual, del fin de la historia a raíz de la implosión del imperio soviético y de la quimera totalitaria de insuflar vida a “un hombre nuevo”, nadie ha vuelto a una definición tan castigada. Se han usado otras caracterizaciones para el supuesto de una inteligencia artificial descontrolada.

En los noventa, Katherine Hayles, catedrática de la Universidad de California que había abandonado la química en favor de la crítica literaria, se atrevió a imaginar la era del poshumanismo. Concibió un mundo en el que no habría lugar para la noción de un homo sapiens diferenciado de la simulación artificial de las computadoras.

Las letras y el cine de ciencia ficción han explorado esa visión en obras como Terminator y Robots Asesinos. Hayles, citada por Avanessian, mostró el abismo: “Nos aterroriza la posibilidad de que una inteligencia superior a la nuestra pudiera ser menos natural o más hostil a la naturaleza que nosotros y nos tratase como seres inferiores, incluso peor de lo que hemos tratado a otras criaturas”. Los más optimistas, como el ex ingeniero de Google Raymond Kurzweil, autor de La singularidad está cerca, han predicho que por desarrollos de la nanotecnología y la robótica podríamos en menos de una década desafiar la mortalidad, causa del pánico más o menos introvertido en que se aúnan en última instancia las angustias humanas. Cifras oficiales indican que en la Argentina hay 15.400 centenarios, número impensable hace 40 años.

Julián Gallo, académico cuyo prestigio en análisis y edición de textos periodísticos se expresa en la plataforma Ualter.AI, giró hace poco el asiento sobre el que trabajaba ante una computadora en Buenos Aires y dirigió la vista hacia atrás, en dirección de su biblioteca. Observó uno de los anaqueles y, apelando en su celular a una de las aplicaciones de ChatGPT -ahora con modalidades para ver, oír y hablar que duplican en meses su capacidad-, tomó una foto y escribió: “Uno de estos libros habla de las jaulas mentales, ¿cuál puede ser?”.

La aplicación contestó: “El libro Cultos: El lenguaje del fanatismo, de Amanda Montelli, que aparece en tu estante, podría ser el que habla de “jaulas mentales”. Este libro -prosiguió la aplicación-explora cómo el lenguaje se utiliza en movimientos de fanatismo para moldear y controlar la mente de las personas, lo cual se relaciona con la idea de “jaulas mentales”. Esos alardes de precisión asombran a quienes a menudo no encontramos un libro que está en algún lugar de la biblioteca hogareña. ChatGPT se permitió, como última deferencia a Julián, un juicio literario: “Si buscas explorar cómo el lenguaje o ciertas ideologías pueden encerrar a las personas en ‘jaulas mentales’, este libro sería una buena elección”.

En la Argentina, el equipo La Nación Data, en coordinación con los de Narrativas Digitales de la Redacción, se ha constituido en referente en el uso de la IA en contenidos periodísticos. La aplicó para comparar en YouTube, en imágenes y palabras, las emociones de los candidatos presidenciales en debates realizados en la Argentina y los Estados Unidos, y para dotar de voz a una carta de treinta y tres páginas que la expresidenta Cristina Kirchner había escrito en duros términos al presidente Javier Milei.

Un tema de poder

En la cartera de clientes de José Gelmini, porteño, coach en aprendizaje computacional, prevalecen más los veteranos que se esfuerzan por no perder el tren de las novedades tecnológicas, que los integrantes de la generación Z, hiperconectados a dispositivos electrónicos, pero de pobre sociabilidad hasta en las mesas navideñas. Gelmini dice que los clientes empiezan a confesar preocupación por el horizonte de la inteligencia artificial. No los tranquilizará con un comentario del pensador israelí Yubal Noah Harari, en su flamante Nexus. Breve historia de las redes de información desde la Edad de Piedra hasta la IA (Ed. Penguin): “Si los ordenadores siguen adquiriendo inteligencia -escribió Harari- podrán desarrollar conciencia y ensayar algún tipo de experiencia subjetiva”.

En esa posibilidad se adentró el novelista inglés Ian McEwan, en Máquinas como yo (2019), examinada por el profesor Pascuale en Las nuevas leyes de la robótica. Charlie, personaje de la penúltima novela de McEwan, compra un robot a fin de matar su aburrimiento, no para que el robot se acostara con Miranda, su vecina. McEwan corrió de ese modo, valiéndose de un conflicto sentimental, el eje del debate en que se trenzan hoy politólogos, científicos y filósofos especulativos. No tanto porque haya llevado el debate a la cama, sino porque lo devolvió a una de las viejas encrucijadas de la humanidad. Con aprobación de Pascuale y no poco cinismo, lo señaló así un perspicaz crítico inglés: “La cuestión de la personalidad de los robots es, en última instancia, un tema de poder, no de reconocimiento de la esencia humana en la IA”.

Las instituciones avanzan con velocidad de tortugas en relación con el vértigo de la creatividad tecnológica. La ley federal de Telecomunicaciones de los Estados Unidos, de fines del siglo XX, todavía exime a los grandes buscadores de cualquier responsabilidad por contenidos publicados por los usuarios, algo que no ocurre con la prensa tradicional. Con olvido de que el lenguaje es clave en los ordenadores, se embreta aun con pereza dentro de la ley la difusión de las fake news y prosperan todavía por las redes mundiales los intereses del narcoterrorismo y las finanzas al margen de la legalidad. O el juego por dinero que hace estragos en el comportamiento y salud de adolescentes, atrapados como zombis en los casinos virtuales.

Infocracia

Byung-Chul Han, filósofo coreano con una vida universitaria en Alemania, acuñó la definición de infodemocracia. Lo hizo por oposición a la democracia fundada en la voluntad popular. Hay poco para celebrar en el sistema infocrático descripto por Han. A diferencia de la estructura anfiteatral de los medios de comunicación de masas, los medios digitales se caracterizan, dice Han, por una estructura rizomática: redes que carecen de un centro. Podría haber dicho que carecen también de identidad y dirección, base de la confiabilidad en el periodismo de calidad desde hace tres siglos.

En el caldo de cultivo de las redes ha prosperado una cultura de agresión verbal feroz, contaminante de otros circuitos de la vida social moderna. En ese conventillo digitalizado, en el que el presidente Milei es quien grita más fuerte en el patio, conviven voces anónimas, voces fanatizadas y voces rentadas para expresarse impunemente; cuentas falsas automatizadas conocidas como bots, y hasta la palabra y los likes de líderes políticos. Nada de esto debe llevarnos a prescindir de que el hartazgo de las sociedades con los viejos moldes de la política, ineficientes y corruptos, se ha hecho sentir como reacción en el lenguaje inaudito que abunda en las redes sociales.

Han observa que en la infocracia ha habido un cambio de paradigmas. Habríamos pasado de la sociedad del espectáculo a la sociedad de la vigilancia. Más que en los gobernantes, ha dicho con acierto, en la infocracia la visibilidad recae sobre los gobernados. Dice Han, como pudo haber dicho Orwell en sus parábolas de los años cuarenta: “Si hasta el robot aspirador inteligente, que nos ahorra la tediosa limpieza, cartografía toda la vivienda”. El derecho a la intimidad es socavado a todo instante por quienes usan nuestros datos al mejor postor o como modelos en el entrenamiento de textos para máquinas digitales. No es una figura retórica hablar, como en los escándalos de la desaparecida Cambridge Analytica, de minería de datos.

Las empresas que orbitan en el mundo digital son profusas en el consumo de minerales: silicio o litio ionizado; energía, agua. El caso de las criptomonedas plantea por su magnitud cuestiones de gravedad estratégica para los Estados. Según un informe de la Universidad de Cambridge, Bitcoin devora alrededor de 121,2 teravatios-hora (TWh) al año, algo más de lo que consumen la Argentina, Noruega y los Países Bajos. La IA devora por igual un caudal monstruoso de energía.

Ha sido una constante histórica la controversia entre actores de las sucesivas etapas de la comunicación y la información. En La guerra de las plataformas, Carlos A. Scolari, catedrático en la Universidad de Pompeu Fabra de Comunicación Digital Interactiva, dice que después de Gutenberg hubo copistas que protestaron por la imprenta. Cita a Elisabeth Eisenstein, historiadora norteamericana que estudió la transición entre el manuscrito y las ediciones masivas. Eisenstein recreó el momento en que el benedictino Filippo di Strata imploró al doge de Venecia que castigara a los tipógrafos que imprimían a un costo insignificante “material que puede, por desgracia, enardecer a jóvenes impresionables”.

Poca cosa, en el fondo, comparada con los pleitos que se plantean con los ordenadores, Internet, las grandes empresas tecnológicas, las redes y, por si fuera poco, los robots y la inteligencia artificial generativa. Sabemos que ninguna es necesariamente buena ni mala: serán lo que el hombre, si se detiene a pensar a tiempo en su destino, quiera que sean.

*Palabras del autor en un encuentro en Madrid de las academias nacionales de Ciencias Morales y Políticas de Argentina y España.