Resulta un poco extraño que la mayoría de los servicios premium de la inteligencia artificial cuesten 20 dólares, ya sea ChatGPT Plus, Claude Pro o Gemini Pro, para mencionar a los más destacados. La coincidencia pareciera estar coordinada, y en cierto modo lo está. Según académicos, no existe un acuerdo explícito entre las empresas, sino una lógica de mercado que impacta, entre otras cosas, en la psicología del consumidor.

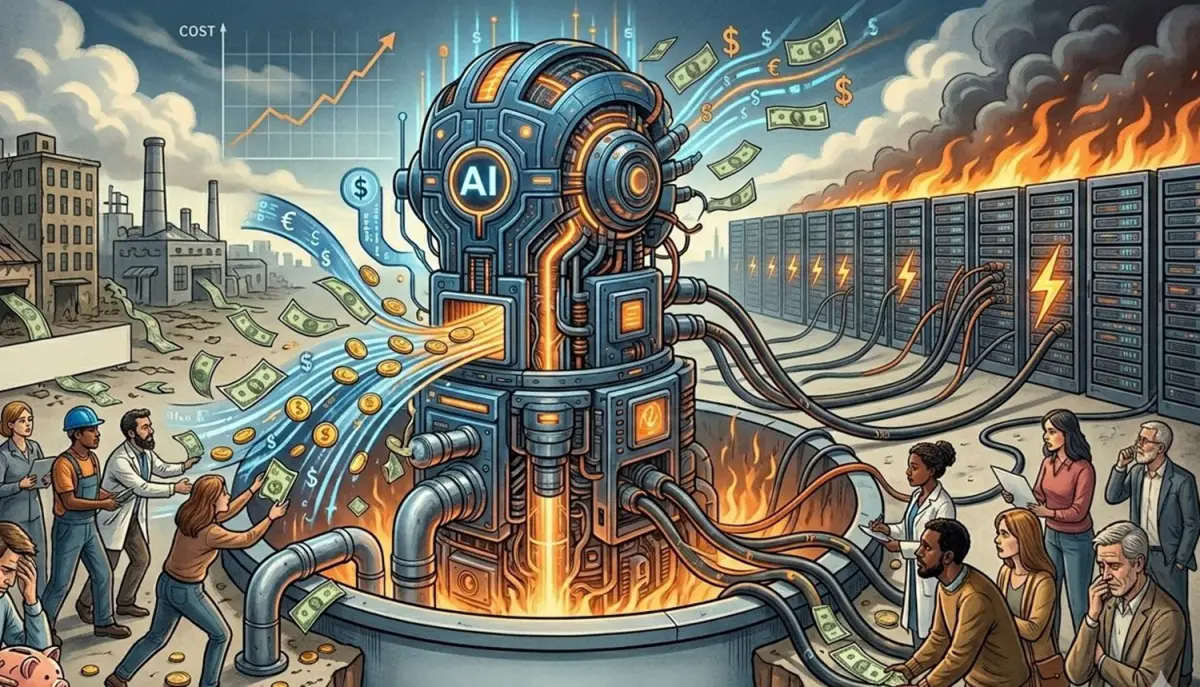

Aquí emerge una doble paradoja sobre el precio de la IA y el tiempo en que lleva congelado. En primer lugar, los avances técnicos hacen que los costos de desarrollo sean menores. Según detalla el informe “AI Index 2025” de la Universidad de Stanford, el costo de procesar un millón de tokens (la unidad básica de las consultas de IA) cayó de 20 dólares en noviembre de 2022 a 0,07 dólares en octubre de 2024. Es decir, una reducción de 280 veces en menos de dos años. Por eso, según estos cálculos, los modelos son más baratos de operar porque la propia IA ayuda a hacer más eficientes todos los procesos. Sin embargo, el usuario sigue pagando lo mismo desde que OpenAI estableció el precio base para el servicio premium. Pero al mismo tiempo, las capacidades más avanzadas de la IA, como la generación de video, razonamiento profundo y los recientes agentes, demandan un poder de cómputo tan alto que esos 20 dólares no alcanzan a pagar el costo.

Estos números no pueden compararse con otra industria, es incluso diferente al sector tradicional del software que conocíamos hasta hace poco. Por eso, algunos especialistas destacan que no se trata de un tema de costos, sino de una estrategia de precios que estableció un ancla psicológica. Si una empresa quisiera cobrar más tendría que mostrar evidencias de calidad en su producto y seguramente afectaría su cuota de mercado. Al mismo tiempo, cobrar menos enviaría señales de debilidad. 20 dólares es el precio que, aparentemente, todos están dispuestos a pagar.

¿Pero quién paga la diferencia?

La respuesta corta es: los inversores. Según documentos financieros obtenidos por el Wall Street Journal en noviembre de 2025, OpenAI gasta aproximadamente 1,69 dólares por cada dólar que ingresa. Y no hay un punto de equilibrio en el corto plazo: la compañía de Sam Altman proyecta pérdidas de alrededor de 74.000 millones de dólares en 2028 y acumulará cerca de 115.000 millones en pérdidas hasta 2029. En otras empresas el panorama es similar. Los márgenes de Anthropic fueron negativos en un 94% en 2024. Y los intentos de ofrecer un servicio súper premium como los planes de 200 dólares al mes aún pierden dinero con los usuarios más activos, porque el costo de servirles supera lo que pagan.

Pero aquí tampoco hay nada nuevo. Este modelo tiene un nombre en la historia de la tecnología reciente y se denomina “subsidio de adopción”. Lo usó Amazon para construir su sistema de servidores AWS, así como Uber para capturar el mercado del transporte. La diferencia es que en esos casos el camino hacia la rentabilidad estaba más claro porque una vez capturado el mercado, los costos marginales caerían y los márgenes escalarían. Pero la economía de la IA no funciona así. A diferencia del software tradicional, donde sumar un usuario nuevo cuesta prácticamente 0, cada consulta de un modelo de lenguaje consume cómputo real. Cuando el uso crece, el costo también lo hace, por lo tanto, es una economía distinta y, por ahora, nadie está cobrando para que el negocio se sostenga en el tiempo.

Pero en el último informe “AI Index 2026” existen pistas para responder este apartado. Los académicos de Stanford cuantificaron la magnitud de la brecha y detallaron que la inversión corporativa global en IA alcanzó los 581.700 millones de dólares en 2025, un crecimiento del 130% respecto al año anterior. Por lo tanto, alguien está pagando esa diferencia y por ahora, son los fondos de capital de riesgo y los grandes proveedores de infraestructura.

Mientras los inversores absorben las pérdidas de las empresas de IA, las grandes tecnológicas no se quedan quietas y comenzaron a trasladar el costo directamente al usuario sin que este lo perciba. Una de ellas es la incorporación forzada de IA en productos, como lo hace Adobe, Microsoft o el propio Google en sus plataformas de Workspace a través de nuevas funcionalidades con leves aumentos de precios. Si el producto tiene la “etiqueta de IA” pareciera funcionar mejor. En otros casos, como en Claude, comienza a variar el precio de los tokens y tiene cuotas de uso a pesar de ser un servicio premium. Si se quiere usar más, hay que pagar más.

El estado de la industria lleva a preguntarse cuánto tiempo puede sostenerse este modelo de sostenibilidad de la IA. En otras palabras: ¿hasta cuándo seguiremos pagando 20 dólares por los servicios premium? Y aún con precios congelados hay que tener en cuenta que los usuarios comienzan a elegir. Como ya pasa con las plataformas de streaming, los consumidores acumulan suscripciones por herramientas que se superponen y la pregunta sobre el valor real comienza a volverse incómoda.

Como en todo proceso de madurez de mercado, lo más probable es que estemos ya viviendo una transición gradual hacia modelos de pago por uso, donde el usuario pague en función del consumo real. De hecho, Claude ya regula los tokens en función del uso en franjas horarias y del modelo que se utiliza, porque no es lo mismo pagar por resumir un texto que para generar video o programar. Pero por ahora, los 20 dólares siguen ahí, atractivos en la mayoría de las plataformas, como si el precio de la inteligencia artificial fuese una. Pero con cada evolución sabemos que no lo es y que sus prestaciones seguirán cambiando. Por ahora, el precio que parece todavía accesible es una promesa con dinero prestado, sostenida por inversores que apuestan a que la demanda justificará, en algún momento, todo lo que se gastó para crearla.