¿Qué es real y qué no en la guerra de Medio Oriente? El peligro de los videos de IA que engañan al mundo

¿Es real lo que ves en tu pantalla? Mientras el conflicto en Medio Oriente se intensifica, una marea de imágenes sintéticas y montajes digitales inunda las plataformas, engañando incluso a los sistemas de verificación más avanzados.

Imagen generada con Inteligencia Artificial

Imagen generada con Inteligencia Artificial

El recrudecimiento del conflicto en Medio Oriente, marcado por los ataques de Estados Unidos e Israel sobre Irán iniciados el pasado 28 de febrero y la posterior respuesta de Teherán, no solo se libra con misiles y drones. En las pantallas de millones de personas, se desarrolla una "cibertrinchera" donde la realidad es la primera víctima. Imágenes generadas por Inteligencia Artificial (IA), videos descontextualizados y, lo más preocupante, algoritmos de verificación que fallan, crearon un ecosistema donde distinguir la verdad es una tarea casi imposible.

El "error" del algoritmo: El caso de la escuela de Teherán

Uno de los episodios más polémicos ocurrió tras el bombardeo de una escuela primaria de niñas en Teherán. Mientras agencias como EFE y Reuters confirmaban la veracidad del ataque y el saldo trágico de víctimas, la herramienta de IA de la plataforma X, denominada Grok, comenzó a etiquetar el contenido como "engañoso".

Mensajes que difunden una foto creada con IA como si fuera el funeral de las víctimas de la escuela de Minab VerificaRTVE/ Getty Images

Mensajes que difunden una foto creada con IA como si fuera el funeral de las víctimas de la escuela de Minab VerificaRTVE/ Getty Images

El sistema de Elon Musk atribuyó erróneamente las imágenes a un atentado del ISIS-K en Kabul ocurrido en 2021. Esta desinformación algorítmica alcanzó las 150.000 visualizaciones, demostrando que incluso las herramientas diseñadas para "contextualizar" pueden convertirse en vectores de mentiras.

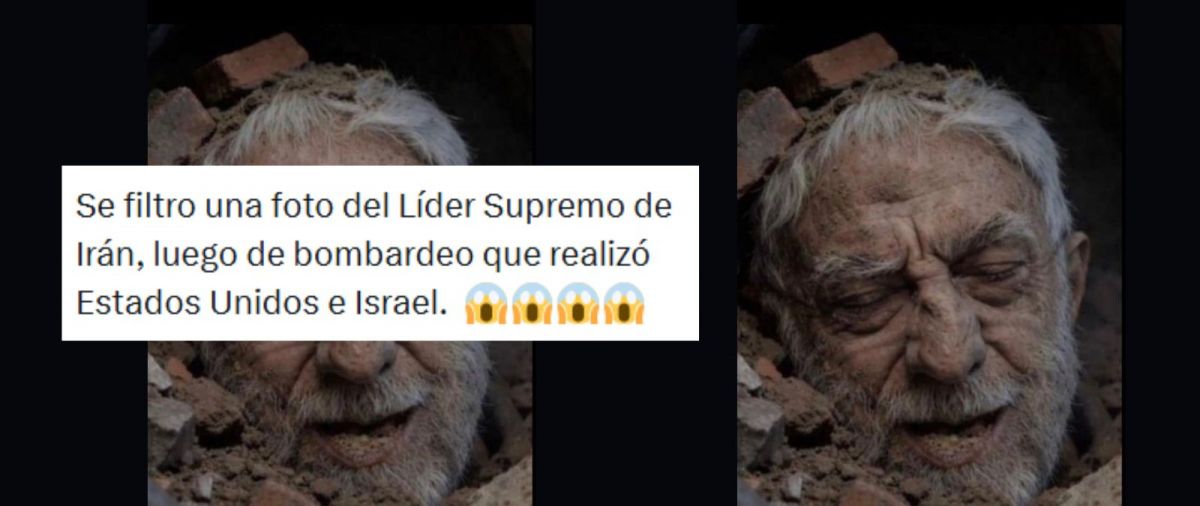

Jamenei y la fábrica de "Fakes"

La muerte del líder supremo de Irán, el ayatolá Alí Jamenei, durante un bombardeo a su residencia, disparó la producción de contenido sintético. En cuestión de horas, circularon imágenes de su supuesto cadáver bajo escombros y fotos de un funeral con ataúd abierto.

Expertos en verificación mediante herramientas como Hive Moderation y Sightengine confirmaron que estas piezas fueron creadas íntegramente con IA. Aunque figuras políticas como Donald Trump y Benjamin Netanyahu habrían tenido acceso a pruebas reales del deceso, las imágenes que inundaron las redes sociales fueron meras construcciones digitales destinadas a manipular la moral pública.

El espejismo de la respuesta iraní

La contraofensiva de Teherán contra Tel Aviv y otros puntos estratégicos en Dubái y Baréin también fue terreno fértil para la manipulación. Videos con millones de reproducciones mostraban rascacielos en llamas y aeropuertos destruidos. Sin embargo, los verificadores de RTVE y Maldita.es demostraron que gran parte de este material era un montaje.

Video del terremoto en Turquía

Video del terremoto en Turquía

En algunos casos, se utilizaron grabaciones del incendio de un edificio residencial en Sharjah de 2015 o escenas de los terremotos de Turquía de 2023, haciéndolas pasar por bombardeos actuales. Otros videos, creados íntegramente con IA, presentaban errores físicos reveladores: personas que aparecían de la nada en medio del caos, objetos que atravesaban paredes y explosiones de luz naranja que desaparecían instantáneamente sin dejar rastro de humo o escombros.

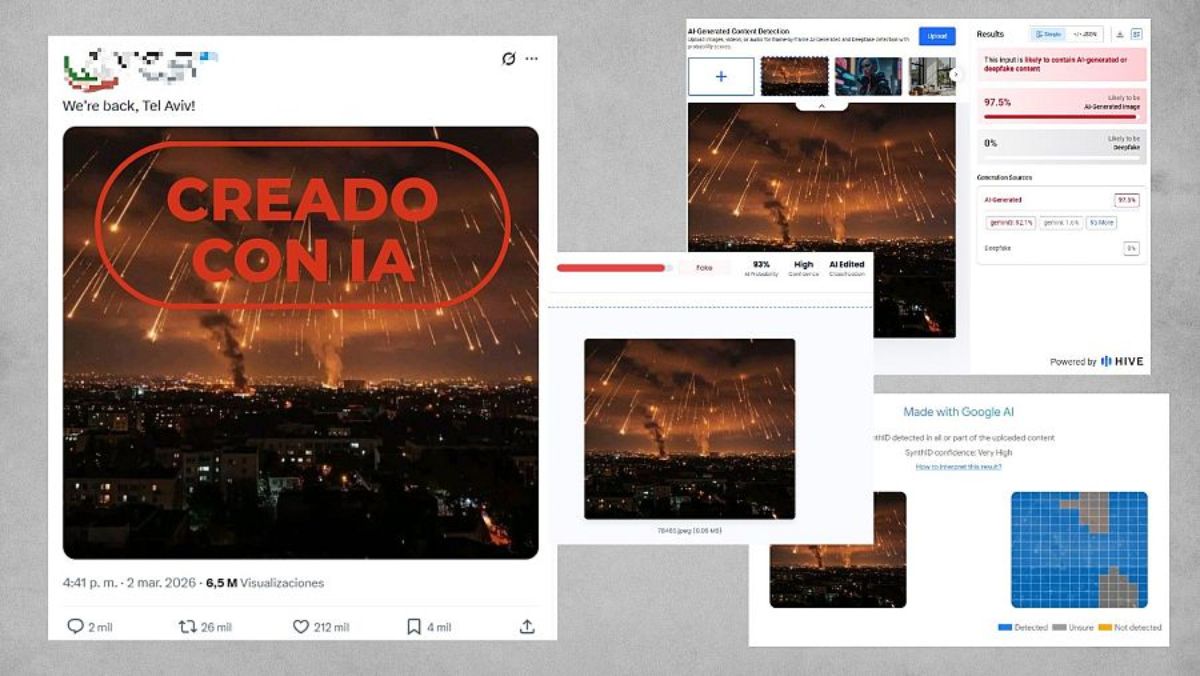

Mensaje que difunde la imagen generada y resultado del análisis con herramientas de detección VerificaRTVE

Mensaje que difunde la imagen generada y resultado del análisis con herramientas de detección VerificaRTVE

La industria del fake y el cansancio informativo

Para Ferran Lalueza, profesor de la UOC, la desinformación en estos conflictos siempre es intencionada y responde a una triple motivación. Por un lado, la económica, ya que el contenido falso genera una tracción masiva en redes que se traduce en ingresos. Por otro, la ideológica, destinada a reforzar prejuicios y generar escepticismo. Finalmente, el puro "troleo", donde individuos buscan gratificación psicológica engañando a las masas.

El peligro reside en que, ante un alud informativo indigerible y plagado de mentiras, la audiencia termina por "aburrirse" o desensibilizarse. Cuando la sociedad deja de confiar en lo que ve, la rendición de cuentas por crímenes de guerra se vuelve imposible. En esta cibertrinchera, el periodismo de verificación y el análisis de datos de código abierto (OSINT) se han convertido en la última línea de defensa de una realidad que parece estar desapareciendo.